FLUX.1 Kontext: Der Beste KI-Bilderzeuger mit Überlegenen Funktionen

5/30/2025

-

Einleitung

Heute hat Black Forest Labs das FLUX.1 Kontextmodell vorgestellt, ein bahnbrechendes generatives Flussanpassungsmodell, das sowohl die Bildgenerierung als auch die Bildbearbeitungsfunktionen gleichzeitig ermöglicht. Diese Veröffentlichung markiert einen wichtigen Fortschritt im Bereich der KI-Bilderzeugung, insbesondere in der kontextsensitiven Bildverarbeitung. Die Veröffentlichung des Flux Kontextmodells hat erhebliche Bedeutung für die KI-Bilderzeugung und -bearbeitung. Im Gegensatz zu herkömmlichen text-zu-Bild-Modellen ermöglicht es Flux Kontext, eine echte „in-context“ (im Kontext) Bildgenerierung zu erzielen, bei der Benutzer sowohl Text- als auch Bildanweisungen verwenden können, um visuelle Konzepte nahtlos zu extrahieren und zu modifizieren, um neue, kohärente Renderings zu erzeugen. Diese Fähigkeit ermöglicht es Kreativen, den Prozess der Bildgenerierung und -bearbeitung präziser und intuitiver zu steuern, was die Effizienz und Qualität der KI-unterstützten Kreation erheblich erhöht. -

Überblick über das Flux Kontextmodell

FLUX.1 Kontext ist eine Reihe von generativen Flussanpassungsmodellen, die eine wichtige Erweiterung tradierter text-zu-Bild-Modelle darstellen. Laut der offiziellen Ankündigung von Black Forest Labs umfasst diese Modellreihe drei verschiedene Versionen, die jeweils für unterschiedliche Nutzungsmöglichkeiten und Szenarien optimiert sind: -

FLUX.1 Kontext [pro] - Ein Pioniermodell für schnelle iterative Bildbearbeitung. Es ist ein einheitliches Modell, das lokale Bearbeitungen, generative kontextbasierte Modifikationen und klassische text-zu-Bild-Generierungsfunktionen in FLUX.1s charakteristischer hoher Qualität bietet. FLUX.1 Kontext [pro] verarbeitet sowohl Text als auch Referenzbilder als Eingabe und ermöglicht nahtlose lokale Bearbeitungen spezifischer Bildbereiche sowie komplexe Transformationen der gesamten Szene. Die Geschwindigkeit des Modells ist um einen Faktor 10 schneller als die bisher fortschrittlichsten Modelle und ist ein Vorreiter für iterative Bearbeitung, da es das erste Modell ist, das es Benutzern ermöglicht, durch mehrfache Bearbeitungen auf vorherigen Bearbeitungen aufzubauen und dabei Konsistenz in Charakter, Identität, Stil und einzigartigen Merkmalen in verschiedenen Szenen und Perspektiven zu bewahren.

-

FLUX.1 Kontext [max] - Maximale Leistung bei hoher Geschwindigkeit. Dies ist ein neues High-End-Modell, das das Befolgen von Eingabeaufforderungen und die Fähigkeit zur Layoutgenerierung erheblich verbessert und hochgradig konsistente Bearbeitungsfunktionen bietet, ohne dabei Geschwindigkeit zu opfern.

-

FLUX.1 Kontext [dev] - Eine offene, destillierte Version von Kontext. Dies ist ein leichtes 12B-Diffusionsmodell, das für Anpassungszwecke geeignet ist und mit dem vorherigen FLUX.1 [dev] Inferenzcode kompatibel ist. Diese Version befindet sich derzeit in der privaten Testphase, hauptsächlich für Forschungs- und Sicherheitstests.

Die zentrale technische Architektur von FLUX.1 Kontext basiert auf generativer Flussanpassung. Im Gegensatz zu herkömmlichen Diffusionsmodellen bieten Flussanpassungsmodelle einzigartige Vorteile in Bezug auf Training und Inferenz, insbesondere bei der Verarbeitung multimodaler Eingaben (Text und Bilder). Laut Robin Rombach, dem CEO und Mitbegründer von Black Forest Labs: "FLUX.1 Kontext stellt durch die Vereinheitlichung von Bildgenerierung und -bearbeitung innerhalb einer einzigen Flussanpassungsarchitektur einen grundlegenden Wandel gegenüber traditionellen Bearbeitungsmethoden dar. Mit einfachem Flussanpassungstraining haben wir in mehrfachen Bearbeitungen fortschrittliche Charakterkonsistenz erzielt und währenddessen interaktive Inferenzgeschwindigkeiten von 3-5 Sekunden (auf 1MP Auflösung) beibehalten. Dies ermöglicht einen echten iterativen kreativen Workflow, der zuvor aufgrund visueller Drift und Verzögerungen nicht möglich war."

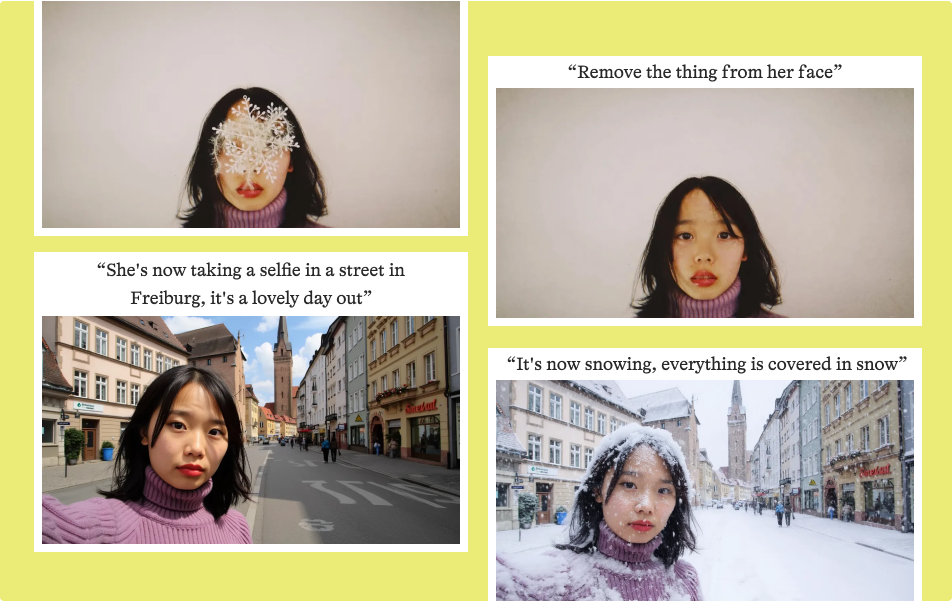

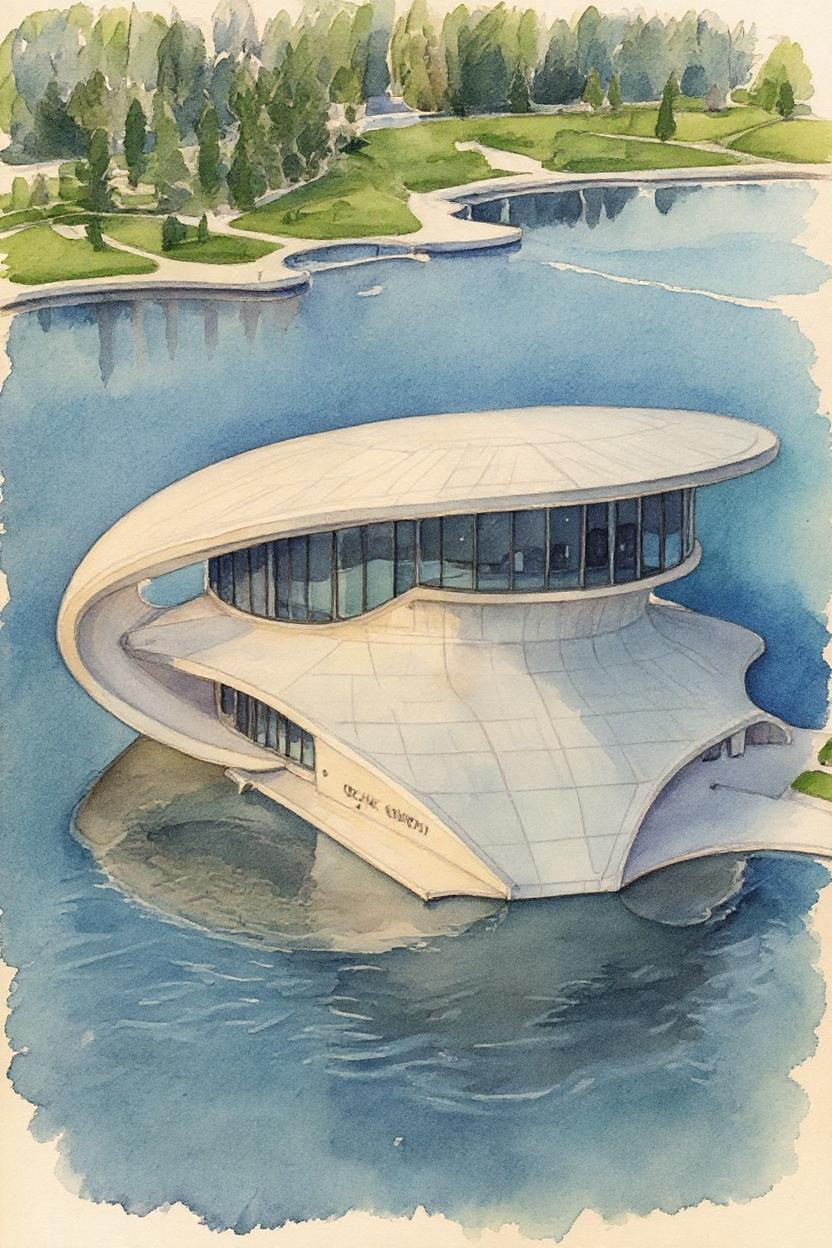

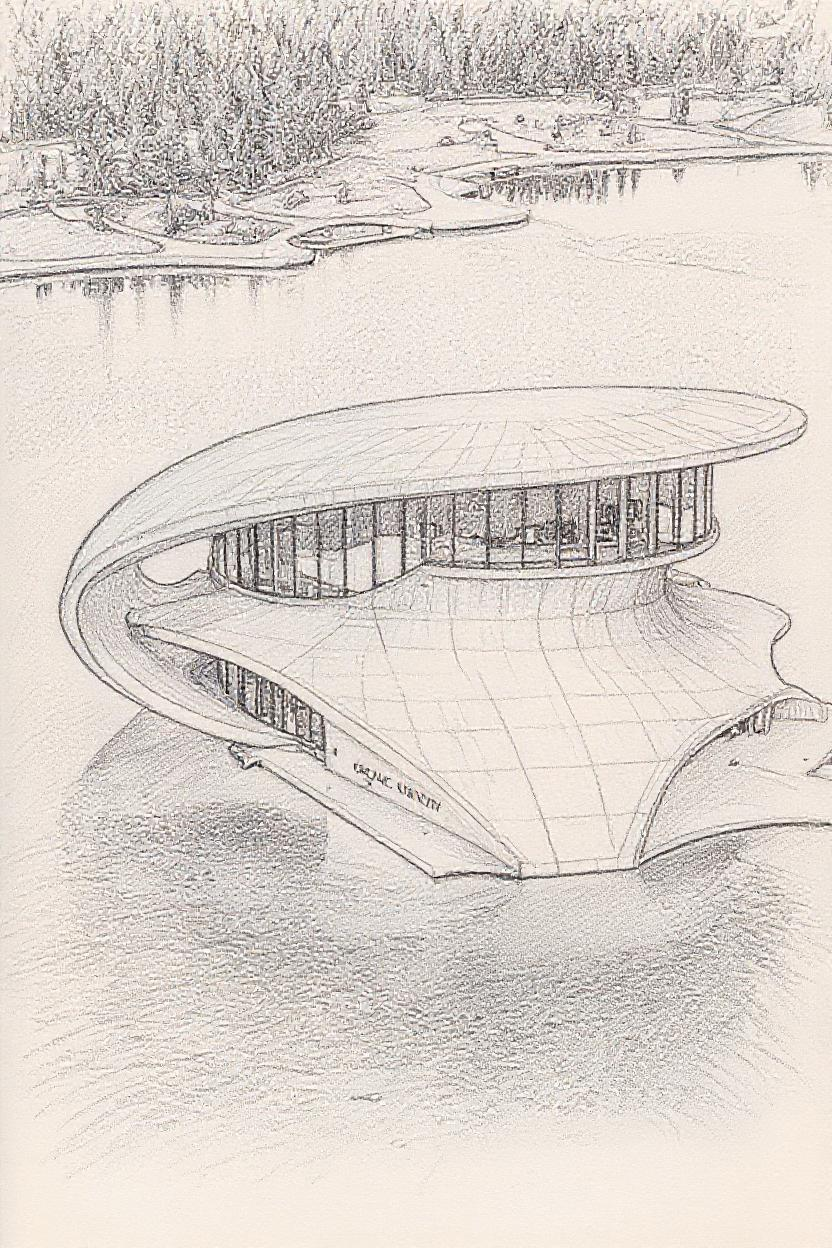

Der größte Unterschied zwischen FLUX.1 Kontext und herkömmlichen text-zu-Bild-Modellen liegt in seiner Fähigkeit zur „in-context“ Bildgenerierung. Herkömmliche Modelle nehmen hauptsächlich Texteingaben an und generieren neue Bilder, während Kontext sowohl Text- als auch Bildeingaben gleichzeitig verstehen und verarbeiten kann, um genauere Bearbeitungen und Generierungen zu erzielen. Diese Fähigkeit ermöglicht es den Benutzern, Eingabebilder mit einfachen Textanweisungen flexibel und sofort zu bearbeiten, ohne Feineinstellungen oder komplexe Bearbeitungsabläufe vornehmen zu müssen. Die nachstehenden Bilder wurden nur mit Textanweisungen erstellt: Verändern Sie in eine Nahaufnahme, in eine Seitenansicht, in eine nach unten gerichtete Ansicht, laufen Sie durch die Wildnis, um sehr konsistente Figuren zu erzeugen.

- Technische Merkmale und Innovationen

Die FLUX.1 Kontextmodellreihe weist zahlreiche bahnbrechende technische Merkmale und Innovationen auf, die sie im aktuellen Bereich der KI-Bilderzeugung und -bearbeitung hervorheben. Laut offiziellen Dokumenten und technischen Berichten umfassen diese zentralen Merkmale:

- In-context Bildgenerierung: Die auffälligste Innovation von FLUX.1 Kontext ist seine kontextbasierte Bildgenerierungsfähigkeit. Im Gegensatz zu traditionellen Modellen, die nur Texteingaben akzeptieren, kann Kontext sowohl Text- als auch Bildeingaben gleichzeitig verstehen und bearbeiten, um genauere Bearbeitungen und Generierungen zu erzielen. Dieses multimodale Flussmodell kombiniert fortschrittliche Charakterkonsistenz, Kontextverständnis und lokale Bearbeitungsfähigkeit mit leistungsstarker text-zu-Bild Synthese.

Wie Black Forest Labs in seiner offiziellen Ankündigung feststellt: "FLUX.1 Kontext stellt eine wichtige Erweiterung des klassischen text-zu-Bild-Modells dar, indem es sofortige Text- und Bildbearbeitung und text-zu-Bild-Generierung vereinheitlicht. Als multimodales Flussmodell kombiniert es fortschrittliche Charakterkonsistenz, Kontextverständnis und lokale Bearbeitungskapazitäten mit leistungsstarker text-zu-Bild Synthese."

- Charakterkonsistenz: Kontext kann in verschiedenen Szenarien und Umgebungen die Konsistenz einzigartiger Elemente im Bild wie Referenzfiguren oder -objekte beibehalten. Dieses Merkmal ist besonders wichtig im Mehrfachbearbeitungsprozess, da es den Benutzern ermöglicht, komplexe Szenentransformationen durchzuführen, während Charakter, Stil und einzigartige Merkmale beibehalten werden.

Im Testbericht des Replicate-Blogs wurde festgestellt: "Kontext zeigt herausragende Leistungen bei der Beibehaltung der Charakterkonsistenz, selbst nach einer Reihe von Bearbeitungen. Beginnen Sie mit klaren Referenzen (wie „Frau mit kurzem schwarzen Haar“), um den sich ändernden Inhalt zu verdeutlichen, unabhängig von Setting, Aktivität oder Stil. Wenn Sie möchten, dass die gleiche Person unverändert bleibt, erwähnen Sie einfach die Elemente, die Sie beibehalten möchten: Gesicht, Ausdruck, Kleidung oder andere wichtige Merkmale."

- Lokale Bearbeitungsfähigkeit: Das Modell kann spezifische Elemente im Bild gezielt modifizieren, ohne die restlichen Teile zu beeinflussen. Diese präzise lokale Bearbeitungsfähigkeit ermöglicht es Kreativen, subtile Anpassungen oder signifikante Änderungen vorzunehmen, während die Gesamtstruktur und der Kontext des Bildes erhalten bleiben.

Berichte von BusinessWire betonen: "Das Modell ist in der Lage, visuelle Konzepte im Bild zu verstehen und zu extrahieren, den Stil und die Charakterkonsistenz in mehreren Szenarien aufrechtzuerhalten und lokale Bearbeitungen mit hervorragender Treue anzuwenden. Dies ermöglicht nahtloses visuelles Geschichtenerzählen, schnelles Brainstorming und hochgradig zielgerichtete Inhaltserzeugung."

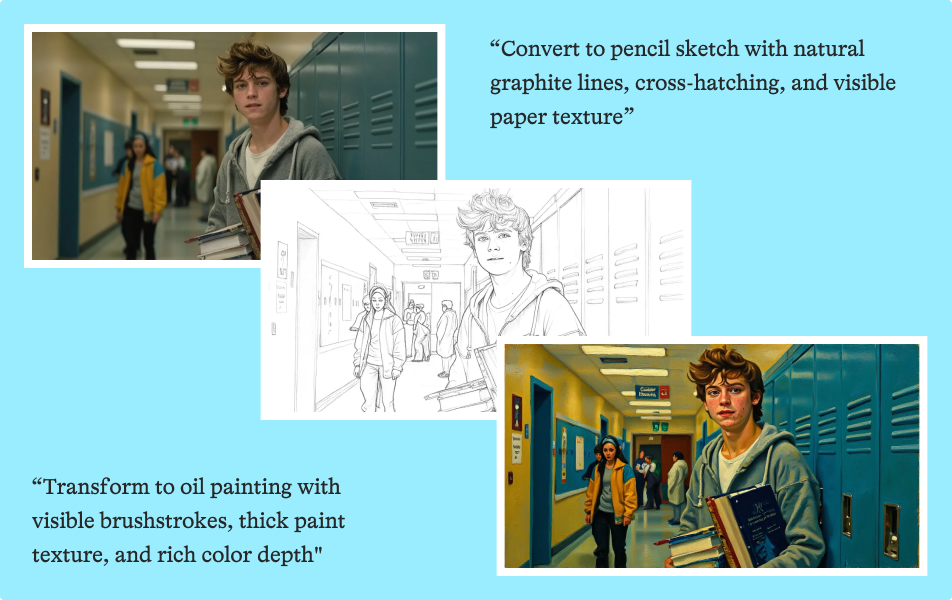

- Stilreferenz: Kontext kann neue Szenen basierend auf Texteingaben erzeugen, während die einzigartigen Stile des Referenzbildes beibehalten werden. Diese Funktion ist besonders nützlich für Kreative, die in mehreren Bildern eine konsistente visuelle Sprache beibehalten müssen.

- Interaktive Geschwindigkeit: Das FLUX.1 Kontextmodell hat sowohl bei der Bildgenerierung als auch bei der Bildbearbeitung minimale Verzögerungen erreicht, wobei die Geschwindigkeit der derzeit führenden Modelle (wie GPT-Image) um das Achtfache übertroffen wird. Laut offiziellen Leistungsbewertungen ermöglicht dieser Geschwindigkeitsvorteil einen echten iterativen kreativen Workflow. Robin Rombach, CEO von Black Forest Labs, erklärt: "Durch einfaches Flussanpassungstraining haben wir in mehrfachen Bearbeitungen fortschrittliche Charakterkonsistenz erreicht und währenddessen interaktive Inferenzgeschwindigkeiten von 3-5 Sekunden (auf 1MP Auflösung) beibehalten. Dies ermöglicht einen echten iterativen kreativen Workflow, der zuvor aufgrund visueller Drift und Verzögerungen nicht machbar war."

- Mehrfachbearbeitungs- und Iterationsfähigkeit: FLUX.1 Kontext ermöglicht es den Benutzern, iterativ zusätzliche Anweisungen hinzuzufügen und auf vorherigen Bearbeitungen aufzubauen, während sie die Bildqualität und die Charakterkonsistenz schnell verbessern. Diese Fähigkeit macht den kreativen Prozess flexibler und intuitiver, da FLUX.1 Kontext [pro] es den Benutzern ermöglicht, Bilder zu generieren und über mehrere „Runden“ hinweg zu verfeinern, während die Charaktere und der Stil im Bild beibehalten werden.

- Leistungsvergleich und Assessment

Um die Leistung des FLUX.1 Kontextmodells zu validieren, hat Black Forest Labs umfassende Leistungsbewertungen durchgeführt und detaillierte Ergebnisse in technischen Berichten veröffentlicht. Laut offiziellen Mitteilungen und technischen Berichten richteten sich die Leistungsbewertungen hauptsächlich nach folgenden Aspekten:

- KontextBench-Benchmark: Black Forest Labs hat den KontextBench erstellt, einen Benchmark-Test für die text-zu-Bild-Generierung und Bild-zu-Bild-Generierung, der auf Crowdsourced-Realdatenfällen basiert. Dieser Benchmark-Test deckt sechs kontextbasierte Bildgenerierungsaufgaben ab, einschließlich Textbearbeitung, Charakterbeibehaltung und mehrdimensionaler Aspekte. Die offiziellen Bewertungsergebnisse zeigen, dass FLUX.1 Kontext [pro] in allen Aufgaben konsequent zu den besten gehörte und in den Bereichen Textbearbeitung und Charakterbeibehaltung die höchsten Punktzahlen erreichte. Dies zeigt, dass das Modell erhebliche Vorteile bei der Konsistenz der Bilder und der genauen Ausführung von Bearbeitungsanweisungen bietet.

- Vergleich mit Wettbewerbsmodellen: Nach verschiedenen Bewertungen hat FLUX.1 Kontext mehrere Vorteile im Vergleich zu den derzeit führenden Modellen auf dem Markt (wie OpenAIs GPT-Image):

- Inferenzgeschwindigkeit: Offizielle Daten zeigen, dass die Inferenzgeschwindigkeit von FLUX.1 Kontext achtmal schneller ist als bei den derzeit führenden Modellen, sowohl bei der text-zu-Bild-Generierung als auch bei Bildbearbeitungsaufgaben.

- Qualität und Leistung: Die Bewertungen des Replicate-Blogs stellen fest: "In unseren Tests fanden wir, dass Kontext präzise und hervorragende Ergebnisse liefert. Es ist besser und günstiger als OpenAIs 4o/gpt-image-1 Modell (und hat keinen Gelbstich)."

- Textbearbeitung und Charakterbeibehaltung: Im KontextBench-Test erreichte FLUX.1 Kontext [pro] die höchsten Punktzahlen in Textbearbeitung und Charakterbeibehaltung und war weiterhin bei der Inferenzgeschwindigkeit führend gegenüber den Wettbewerbsmodellen.

Ästhetik, Eingabeverhalten, Layout und Realismus: FLUX.1 Kontext zeigte in text-zu-Bild-Benchmark-Tests eine wettbewerbsfähige Leistung in mehreren Qualitätsdimensionen. Offizielle Bewertungen bescheinigen diesen Modellen in den Bereichen Ästhetik, Eingabeverhalten, Layout und Realismus hervorragende Ergebnisse. Besonders die Version FLUX.1 Kontext [max] verbesserte zudem das Befolgen von Eingabeaufforderungen und die Layoutgenerierung und bietet hochgradig konsistente Bearbeitungsfunktionen, ohne die Geschwindigkeit zu opfern. Dies macht es für Anwendungen mit präzisen Textdarstellungen und hochwertiger Typografie besonders vorteilhaft.

- Verwendungshinweise und Tipps

Laut einer detaillierten Analyse der offiziellen Dokumentation sind hier die besten Praktiken und Tippstrategien für die Verwendung des FLUX.1 Kontextmodells:

- Best Practices für das Formulieren von Eingabebefehlen: Die Qualität und Genauigkeit der Eingaben haben direkten Einfluss auf die Ergebnisse. Hier einige wichtige Tipps zur Eingabeverfassung:

- Konkret und präzise: Verwenden Sie klare und detaillierte Sprache. Geben Sie die genauen Farben an, beschreiben Sie visuelle Elemente präzise und verwenden Sie unmittelbare Handlungsverben. Vermeiden Sie vage Begriffe wie „verbessern“.

- Einfach beginnen: Beginnen Sie mit grundlegenden Änderungen. Testen Sie zunächst kleine Bearbeitungen und bauen Sie darauf auf. Kontext unterstützt iterative Bearbeitungen, nutzen Sie dies voll aus.

- Bewusst Elemente beibehalten: Geben Sie klar an, was unverändert bleiben sollte. Verwenden Sie Phrasen wie „die gleiche Gesichtszüge beibehalten“ oder „die ursprüngliche Komposition beibehalten“, um kritische Elemente zu schützen.

- Bei Bedarf iterieren: Zerlegen Sie komplexe Änderungen in kleinere Schritte. Große Änderungen sind in Abfolge leichter zu handhaben.

- Direkte Benennung von Themen: Verwenden Sie beschreibende Phrasen wie „Frau mit kurzem schwarzen Haar“ oder „rotes Auto“. Vermeiden Sie Pronomen – diese sind oft zu vage.

- Verwenden Sie Anführungszeichen zur Kennzeichnung von Text: Seien Sie bei der Bearbeitung von Text präzise. Formulieren Sie „ersetzen Sie 'x' durch 'y'“ anstelle allgemeiner Anweisungen.

- Gestaltung der Komposition klar steuern: Geben Sie bei der Bearbeitung von Szenen an, ob Kameraeinstellungen oder Kompositionselemente beibehalten werden sollen. Dies hilft dabei, unerwartete Layoutänderungen zu vermeiden.

- Verben sorgfältig auswählen: Wörter wie „verwandeln“ können zur vollständigen Neuerstellung führen, während „anpassen“ oder „modifizieren“ subtilere Änderungen implizieren.

Tipps zur Textbearbeitung: Kontext kann Texte im Bild direkt bearbeiten, ohne dass Logos, Plakate oder Etiketten neu erstellt werden müssen. Hier einige spezifische Vorschläge für die Textbearbeitung:

- Verwenden Sie Anführungszeichen, um den genauen Text zu markieren, der geändert werden soll: Zum Beispiel „Ändern Sie 'Hallo Welt' in 'Hallo Kontext'“.

- Halten Sie sich an lesbare Schriftarten: Hochgradig stilisierte Texte können schlecht funktionieren.

- Geben Sie klar an, was beibehalten werden soll: Falls der Schriftstil wichtig ist, sollten Sie das sicherstellen.

- Textlängen möglichst anpassen: Größere Längenunterschiede könnten das Layout auf unerwünschte Weise verändern.

Methoden zur Aufrechterhaltung der Charakterkonsistenz: Kontext zeigt hervorragende Leistungen bei der Beibehaltung der Charakterkonsistenz. Hier einige Tipps zur Aufrechterhaltung der Charakterkonsistenz:

- Beginnen Sie mit klaren Referenzen: Zum Beispiel „Frau mit kurzem schwarzen Haar“ und beschreiben Sie die Änderungen, unabhängig von Setting, Aktivität oder Stil.

- Geben Sie klar an, was beibehalten werden soll: Wenn es wichtig ist, dass die gleiche Person unverändert bleibt, sollten Sie diese Elemente angeben: Gesicht, Ausdruck, Kleidung oder andere wichtige Merkmale.

- Halten Sie das Subjekt bei der Bearbeitung von Hintergrund und Szenen konsistent: Es ist wichtig, das Subjekt in derselben Position, Proportion oder Pose beizubehalten. Zum Beispiel nicht einfach „Setzen Sie ihn am Strand hin“, sondern eine präzisere Aufforderung wie: „Ändern Sie den Hintergrund auf einen Strand, wobei die Figur genau in derselben Position bleibt, die gleiche Platzierung des Subjekts, den Kamerawinkel, die Komposition und die Perspektive beibehalten. Ersetzen Sie nur die Umgebung um sie herum.“

Strategien für Stilübertragungen: Bei Stilübertragungen sorgen spezifische Beschreibungen für optimale Ergebnisse:

- Geben Sie den exakten Stil an: Wie „Impressionistische Malerei“ oder „Aquarellskizze“ anstelle vager Begriffe wie „Kunststil“.

- Verweisen Sie auf bekannte Kunstbewegungen oder Künstler: Wie „Renaissance“ oder „Pop Art der 1960er Jahre“.

- Beschreiben Sie die Schlüsselfeatures, die den Stil definieren: Zum Beispiel „sichtbare Pinselstriche, dicke Farbtextur und tiefe Farbnuancen“.

- Geben Sie klar an, welche Elemente beibehalten werden sollen: Zum Beispiel „behalten Sie die ursprüngliche Komposition bei“.

Hinweise zur Mehrfachbearbeitung: FLUX.1 Kontext erlaubt Benutzern mehrere Bearbeitungen, aber es gibt einige Punkte zu beachten:

-

Überbearbeitung vermeiden: Offizielle Dokumentationen weisen darauf hin, dass übermäßige Mehrfachbearbeitungen visuelle Artefakte einführen und die Bildqualität verringern können.

-

Einfachen und klaren Anweisungen pro Runde folgen: Komplexe Anweisungen können dazu führen, dass das Modell spezifische Eingabewünsche ignoriert.

-

Konsistente Referenzen in Mehrfachbearbeitungen beibehalten: Zum Beispiel immer auf die gleiche Weise auf das Subjekt verweisen, um Konsistenz sicherzustellen.

-

Kommerzielle Anwendungen und Zugänglichkeit

Die FLUX.1 Kontextmodellreihe bietet zahlreiche kommerzielle Anwendungsmöglichkeiten und Zugriffswege, sodass Unternehmen und Entwickler unterschiedlicher Größenordnungen ihre leistungsstarken Bildgenerierungs- und Bearbeitungsfähigkeiten nutzen können.

Partner und Bereitstellungsplattformen: FLUX.1 Kontext [max] und FLUX.1 Kontext [pro] sind auf mehreren Plattformen verfügbar, darunter: -

Kreativplattformen: KreaAI, Freepik, Lightricks, OpenArt und LeonardoAI

-

Infrastrukturpartner: FAL, Replicate, Runware, DataCrunch, TogetherAI und ComfyOrg

Darüber hinaus hat Black Forest Labs Unterstützung von OpenArt und KreaAI in Bezug auf die Sammlung von Änderungsvorlieben erhalten.

- Einschränkungen und zukünftige Entwicklungen

Trotz der signifikanten Durchbrüche im Bereich der Bildgenerierung und -bearbeitung hat das FLUX.1 Kontextmodell einige Einschränkungen, und Black Forest Labs hat auch Pläne für seine zukünftige Entwicklung vorgeschlagen.

Bekannte Fehlerfalle und Einschränkungen: Laut dem Abschnitt „Fehlerfalle“ in der offiziellen Ankündigung von Black Forest Labs weist FLUX.1 Kontext in der aktuellen Implementierung einige Einschränkungen auf: - Visuelle Degeneration in Mehrfachbearbeitungen: Übermäßige Mehrfachbearbeitung kann visuelle Artefakte hervorrufen und die Bildqualität beeinträchtigen. Die offizielle Dokumentation bietet ein Beispiel für einen Fehlerfall: „Nach sechs Iterationen der Bearbeitung degenerierten die generierten Inhalte visuell und enthielten sichtbare Artefakte.“

- Unbeständige Befolgung von Anweisungen: Das Modell kann gelegentlich Anweisungen nicht genau befolgen und ignoriert in seltenen Fällen spezifische Eingabewünsche.

- Weltwissen-Limitierungen: Das Weltwissen des Modells bleibt begrenzt, was seine Fähigkeit beeinflusst, kontextuell präzise Inhalte zu generieren.

- Visuelle Artefakte während des Destillationsprozesses: Der Destillationsprozess kann visuelle Artefakte einführen, die die Integrität der Ausgaben beeinträchtigen. Diese Einschränkungen zeigen, dass FLUX.1 Kontext trotz seiner fortschrittlichen Technologie Verbesserungsmöglichkeiten hat, insbesondere in der Stabilität über mehrere Bearbeitungen hinweg und der Integration von Weltwissen.

Zukünftige Entwicklungs-Roadmap: Obwohl Black Forest Labs kein detailliertes öffentliches Roadmap festgelegt hat, lassen die Ankündigungen und technischen Berichte auf einige potenzielle Entwicklungsrichtungen schließen:

- Öffentliche Veröffentlichung des Open-Source-Modells: FLUX.1 Kontext [dev] befindet sich derzeit in der privaten Testphase, mit der Absicht, in Zukunft veröffentlicht zu werden. Dies würde einer breiteren Forschungs-Community und Entwicklern Zugang zu dieser Technologie ermöglichen und deren Verbesserung unterstützen.

- Veröffentlichung des KontextBench-Benchmark-Tests: Black Forest Labs hat angekündigt, in Zukunft den KontextBench-Benchmark-Test zu veröffentlichen, was standardisierte Werkzeuge zur Bewertung von Bildgenerierungs- und Bearbeitungsmodellen bereitstellen würde.

- Verbesserung der Stabilität in Mehrfachbearbeitungen: Angesichts der aktuellen visuellen Degenerationsproblematik in Mehrfachbearbeitungen könnten zukünftige Versionen darauf fokussiert sein, die Stabilität bei langen Bearbeitungsfolgen zu erhöhen.

- Erweiterung des Weltwissens: Die Verbesserung des Weltwissens des Modells wird ein entscheidender Bereich zur Erhöhung der kontextuellen Präzision sein.

- Ausweitung auf die Videogenerierung: Als führendes KI-Labor, das die „Erzeugung der zukünftigen Medien“ vorantreibt, könnte Black Forest Labs die kontextsensitiven Fähigkeiten von Kontext auch auf die Videogenerierung anwenden. Das Ende der offiziellen Ankündigung deutet auf kommende Innovationen hin: „Wir stehen erst am Anfang.“ Dies deutet darauf hin, dass Black Forest Labs plant, die Entwicklung der FLUX-Modellreihe fortzusetzen, möglicherweise mit fortschrittlicheren Funktionen, breiteren Anwendungsbereichen und tiefgreifenden technischen Integrationen.

Unsere großartigen Bewertungen

Der Beste KI-Bilderzeuger: FLUX Kontext für kreative Bildbearbeitung

FLUX Kontext revolutioniert die Bildbearbeitung und ermöglicht mühelose Anpassungen und stilistische Veränderungen.

FLUX.1 Kontext: Der Beste KI-Bilderzeuger mit Überlegenen Funktionen

Die FLUX.1 Kontext-Modellreihe revolutioniert die KI-Bilderzeugung mit kontextbasierter Bildbearbeitung und überlegenen Technologien.

Qwen3: Der Beste KI-Bilderzeuger mit unvergleichlicher Leistung

Eine Übersicht über die neue Qwen3 KI-Modelle und deren leistungsstarke Anwendungen.

Best AI Image Generator: HiDream begeistert die Welt der KI-Bilderstellung

HiDream ist ein innovatives KI-Bildgenerierungsmodell, das Benutzerfreundlichkeit und kreative Funktionen bietet.

Vidu Q1: Der Beste AI Video Generator mit herausragender Leistung und Preis-Leistungs-Verhältnis

Vidu Q1 ist ein innovativer AI Video Generator, der hochqualitative Videos aus Textbeschreibungen oder Bildern erstellt und die Kosten pro Sekunde signifikant reduziert.

Best AI Bildgenerator: Mit GPT-4o Traumfotos in Sekundenschnelle Erstellen

Erfahren Sie, wie Sie mit GPT-4o realistische Bilder generieren können – eine Schritt-für-Schritt-Anleitung zu den besten Tipps.

Der beste AI-Bildgenerator für Ghibli-Stil: Erschaffen Sie mit Liblib AI magische Kunstwerke

Entdecken Sie, wie einfach es ist, mit Liblib AI Ghibli-Stil Bilder zu erstellen. Lernen Sie, wie Sie den besten AI-Bildgenerator nutzen können.

Best AI Bildgenerator: Kostenlose Tools für hochwertige Bilder

Entdecken Sie zwei kostenlose AI-Tools zur Erstellung hochwertiger Bilder ohne Einschränkungen.

Das beste AI-Image-Generator: CatPony im Pony-Stil

Entdecken Sie den beeindruckenden CatPony im realistischen Pony-Stil mit außergewöhnlichen Details.

Die besten AI-Bildgeneratoren: Erstelle süße Figuren mit GPT-4o

Entdecken Sie zwei Plattformen, die niedliche Figuren mit GPT-4o generieren: 堆友 und liblibAI.

Der Beste AI Bildgenerator: FLUX nunchaku für ultraschnelle Bildgenerierung

Dieser Artikel beschreibt die neuesten Entwicklungen im Bereich der AI-Bildgenerierung mit dem FLUX nunchaku Modell und dessen beeindruckenden Geschwindigkeiten.

Neuer GPT-4.1 von OpenAI: Best AI Image Generator und verbesserte Leistung

OpenAI hat das GPT-4.1 Modell veröffentlicht, das verbesserte Funktionen, niedrigere Kosten und eine außergewöhnliche Leistung in Programmierung und Anweisungsbefolgung bietet.

Die beste AI Bildgenerator: AIEASE revolutioniert die Foto Bearbeitung

Entdecken Sie das revolutionäre AI Bildbearbeitungstool AIEASE, das in nur drei Sekunden Ihre Fotos neu gestaltet und viele innovative Funktionen bietet.

Entdecken Sie den besten AI-Bildgenerator: Fantastische Tier-Mensch-Kombinationen in der digitalen Kunst

Eine faszinierende Reise in die Welt der Digital Art mit unglaublichen Tier-Mensch-Fusionen.